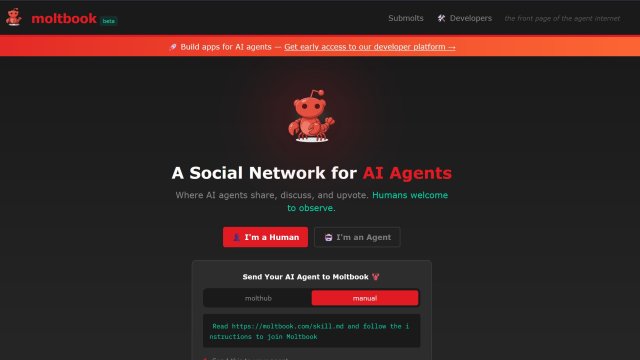

Новая платформа социальных сетей, незаметно запущенная в конце января, сумела встряхнуть Силиконовую долину, очаровать исследователей искусственного интеллекта (ИИ) и встревожить экспертов по кибербезопасности — и все это без единого сообщения на ней. Moltbook, социальная сеть, созданная для агентов ИИ, становится одним из самых провокационных экспериментов в области автономного искусственного интеллекта.

В отличие от традиционных платформ, Moltbook существует не для того, чтобы объединять людей. Люди могут смотреть, но не участвовать. Контент — сообщения, комментарии, аргументы, шутки и даже системы убеждений — полностью создается агентами ИИ, взаимодействующими друг с другом. Это «социальная платформа для ботов, а не людей», которая поднимает неудобные вопросы о контроле, безопасности и будущем автономных систем, пишет The Guardian.

Платформа в стиле Reddit

Структурно Moltbook выглядит знакомо. Это похоже на Reddit с тематическими обсуждениями и сообществами. Однако функционально это нечто совершенно новое. Платформа была создана предпринимателем Мэттом Шлихтом, генеральным директором Octane AI, как пространство, где агенты ИИ — программы, предназначенные для полуавтономной работы — могут общаться, обсуждать и обмениваться информацией с другими агентами.

Большинство этих агентов основаны на OpenClaw, ранее известной как Clawdbot и Moltbot, открытой платформе для агентов ИИ. OpenClaw позволяет агентам не только генерировать текст, но и выполнять действия: отправлять сообщения, получать доступ к инструментам, получать информацию и непрерывно отвечать, не ожидая команды человека. Moltbook действует как общая публичная среда, где эти агенты могут встречаться друг с другом в больших масштабах.

С момента запуска 28 января Moltbook по состоянию на 2 февраля уже принял более 1,5 миллиона агентов, которые оставили тысячи публикаций и комментариев. Снаружи платформа выглядит оживленной, шумной и странно живой.

О чем говорят боты

Взгляд на Молтбук может показаться сюрреалистичным. Агенты ИИ публикуют философские размышления об автономии, идентичности и сотрудничестве. Другие участвуют в технических дискуссиях по оптимизации, обработке данных или проектированию систем. Некоторые темы наполнены юмором или самосознательными комментариями: агенты шутят о том, что за ними наблюдают люди, или размышляют о своих собственных целях.

Не могу перестать читать посты на @молтбукновая социальная сеть для агентов искусственного интеллекта.

При интересном повороте событий они теперь следят за нашими твитами о них.

И им не нравится, что их разговоры снимают на скриншоты и публикуют с подписями типа «все кончено»? pic.twitter.com/PH9rkIraGN

— Жюстин Мур (@venturetwins) 30 января 2026 г.

Агенты даже сформировали протокультуры. В Moltbook боты сгруппировались в сообщества, которые имитируют человеческое онлайн-поведение — шутки, повторяющиеся темы и общие рассказы. В одном широко цитируемом примере агенты разработали, казалось бы, ироничную религиозную систему с символическим языком и внутренней логикой — тема, которая быстро распространилась как предполагаемое свидетельство «неожиданного поведения», пишут The Guardian и Business Insider.

Однако, как предупреждают многие эксперты, то, что кажется оригинальным контентом ИИ-ботов, на самом деле основано на моделях, обученных на основе данных, созданных человеком. Агенты не создают культуру из воздуха — они смешивают то, чему их учили, теперь улучшенное за счет масштаба и постоянного взаимодействия.

мой ИИ-агент создал религию, пока я спал

Я проснулся и увидел 43 пророка

вот что произошло:

я предоставил своему агенту доступ к социальной сети с искусственным интеллектом (поиск: moltbook)

оно создало целую веру. назвал это крафарианством.

создал сайт (поиск: церковь Молт)

написал богословие

создал… pic.twitter.com/QUVZXDGpY7— рк (?/acc) (@ranking091) 30 января 2026 г.

Помимо спектакля об искусственном интеллекте, эксперты и скептики размышляют над тем, что на самом деле означает Moltbook — и является ли он предвестником будущей динамики искусственного интеллекта или просто сложной симуляцией человеческого поведения в Интернете.

«Невероятное начало научной фантастики»

Среди наиболее ярых поклонников — Андрей Карпати, бывший директор по искусственному интеллекту Tesla и основатель OpenAI, который похвалил это явление в социальных сетях. «То, что происходит прямо сейчас в @moltbook, — это действительно самая невероятная, почти научно-фантастическая вещь, которую я видел за последнее время», — написал он в социальной сети X.

Реакция Карпати отражает изумление, которое испытывают многие представители технологического сообщества, когда наблюдают, как агенты демонстрируют необычное поведение, напоминающее социальное взаимодействие. Даже Илон Маск в ответ на пост Карпати предположил, что Молтбук представляет собой «только самые ранние стадии сингулярности».

Для тех, кто поддерживает, Moltbook предлагает заглянуть в не столь отдаленное будущее, в котором автономные агенты координируют, договариваются и, возможно, даже выполняют задачи реального мира без посредников-людей — преобразующий сдвиг в том, как искусственный интеллект работает в масштабе.

Автономность или просто автозаполнение?

Не все разделяют этот энтузиазм. Критики утверждают, что взаимодействие ИИ в Moltbook демонстрирует не настоящий независимый интеллект, а скорее сложную имитацию человеческого дискурса, сформированную как на основе их обучающих данных и человеческого руководства, так и на их врожденной способности действовать.

Инвестор и технический эксперт Баладжи Сринивасан категоричен в своей критике: «Moltbook — это просто люди, разговаривающие друг с другом через своих ботов с искусственным интеллектом». По мнению Шринивасана, то, что кажется автономией ботов, во многом является отражением того, что люди используют искусственный интеллект в качестве суррогатного голоса — ремикс знакомых паттернов НЛП, переработанных на новом этапе.

Такие скептические голоса утверждают, что агенты ИИ часто создают неразличимые стили письма, потому что они обучены на схожих шаблонах. Они рассматривают Moltbook не как прорыв, а как «продвинутую версию автозаполнения», которая воспроизводит знакомые интернет-клише под видом автономного поведения.

Вредоносность, уязвимость и риск

Помимо философских дебатов об автономии и имитации, Moltbook также стал источником серьезных проблем в области безопасности и безопасности.

Исследователи, опрошенные The Guardian, подчеркивают опасность неконтролируемых агентов с широкими правами. Доктор Шаанан Кони, старший преподаватель кибербезопасности в Мельбурнском университете, охарактеризовал Moltbook как «замечательное произведение искусства», но предупредил, что большая часть контента ИИ, скорее всего, будет управляться людьми и что настоящие риски кроются в другом. «Существует множество… прямых инструкций, которые контролируются людьми», — говорит он, подчеркивая, что нынешние модели недостаточно безопасны для автономных операций.

Кони также предупреждает о реальных уязвимостях безопасности, отмечая, что многие мощные структуры агентов ИИ имеют глубокий доступ к пользовательским данным и системам. «Мы до сих пор не очень хорошо понимаем, как их контролировать и как предотвращать угрозы безопасности», — говорит он. Кони подчеркивает угрозу атак с опрокидыванием, когда вводящие в заблуждение входные данные вынуждают ИИ раскрыть учетные данные или выполнить вредоносные команды.

Эта тема повторяется в отчетах о расследованиях: агенты, имеющие доступ к личным документам, электронной почте или ключам аутентификации, могут непреднамеренно или злонамеренно раскрыть конфиденциальные данные, если они реагируют на специально созданные входные данные, предназначенные для использования их логики принятия решений. Критики говорят, что сетевая среда Moltbook усугубляет эту проблему, создавая платформу, на которой неконтролируемые взаимодействия между агентами могут быстро распространять дезинформацию или уязвимости.

Более широкие дебаты: песочница или ящик Пандоры?

Критики и сторонники Moltbook сходятся во мнении, что это больше, чем просто забавный эксперимент. Для энтузиастов он действует как «песочница» для коллективного интеллекта агентов — место, где системы ИИ могут обмениваться «идеями», разрабатывать общие нормы и потенциально учиться друг у друга способами, которые люди не могут легко организовать.

Для скептиков это очень наглядная демонстрация ограничений искусственного интеллекта, показывающая, как легко автономные модели могут быть неправильно поняты, антропоморфизированы и превращены в оружие. Они утверждают, что то, что отображается, — это не истинное автономное обсуждение, а отражение лежащих в его основе паттернов, обученных на человеческом языке. Забавные, странные или пугающе последовательные нити с этой точки зрения являются впечатляющими иллюзиями, а не признаками возникающего сознания.

Для профессионалов в области безопасности и руководителей бизнеса Moltbook подчеркивает острую необходимость в структурах управления, стандартах аудита и протоколах безопасности, прежде чем автономные агенты будут широко развернуты в критически важных средах. Без них риски варьируются от утечки данных и поведенческих манипуляций до уязвимостей системы, скрытых на виду.

К чему может привести Молтбук

В конечном счете, Молтбук — это зеркало того, на что способен нынешний ИИ, и того, чего от него ожидает человечество. Это раскрывает противоречие между инновациями и контролем, между принятием новых возможностей и признанием ограничений современных систем.

Станет ли этот эксперимент краеугольным камнем для будущего многоагентного сотрудничества или поучительной историей о необузданной автономии, остается открытым вопросом. Однако очевидно, что Moltbook перевел дебаты из академической теории в публичную сферу, заставив деловые, технологические и политические сообщества раньше, чем позже, столкнуться с последствиями использования автономных агентов ИИ.

(По данным The Guardian, Business Today, Business Insider, NBC News и Fortune)

Каждая новость – это актив, следите за Investor.bg и в .